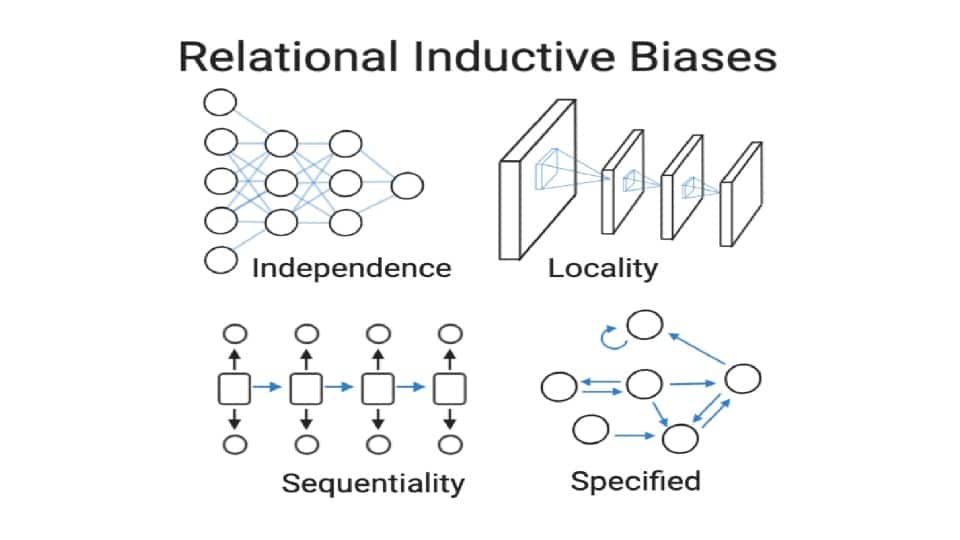

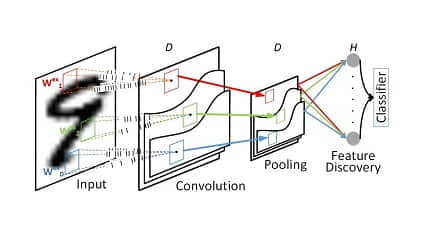

هر مدلی برای یادگیری نیاز به یکسری پیش فرضها دارد که لازم است برقرار باشند تا مدل یادگیری به درستی کار کند. این فرضها مواردی هستند که در حین اجرای روش یا در روابطش نیاز می شوند. برای عنوان کردن مثالی ساده، به ساخت ساختمان اشاره می کنیم. کسی که سابقه ساخت ساختمان داشته باشد، پیش از ساخت و با توجه به نیازها می داند که برای مثال لازم است که بودجه ای مشخص با ابزارآلاتی خاص فراهم آیند تا در حین ساخت ساختمان با مشکل روبه رو نشویم. به عبارتی، می توان گفت که وجود جرثقیل یکی از پیش فرضهایی است که لازم است در نظر گرفته شود تا ساخت ساختمان ممکن شود. در مورد مدل های یادگیری نیز چنین است. اگر مثلا گفته می شود که نیاز است در شبکه های عصبی داده های i.i.d داشته باشیم، به این خاطر است که در بدنه روش یادگیری این فرض به ما کمک می کند تا cost function مناسب داشته باشیم. یکی از مواردی که خیلی در ساخت مدل های عمیق اهمیت دارد، توجه به همین inductive bias است. در شبکه های کانولوشنی، فرض این است که ویژگی های پیکسل های کنار هم در سرتاسر عکس ممکن است تکرار شوند یا در شبکه های حافظه دار، توالی time step ها در نظر گرفته می شود. در این زمینه می توان نوآوری های جالبی با توجه به ساختارهای داده هایی که اصطلاحا structure ندارند، داشت.

نوشته شده بوسیله:

کامران پناهی

کارشناسی ارشد هوش مصنوعی

علاقه مند به یادگیری عمیق