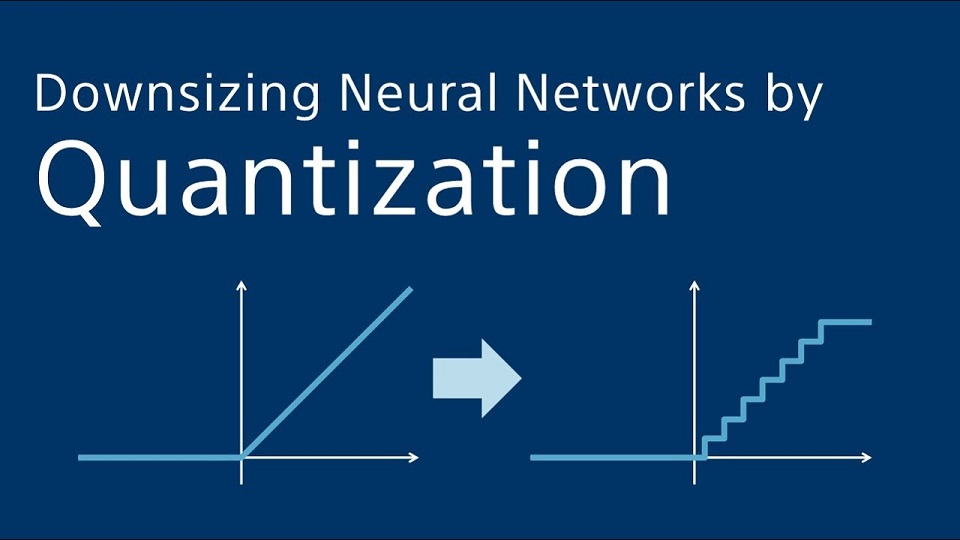

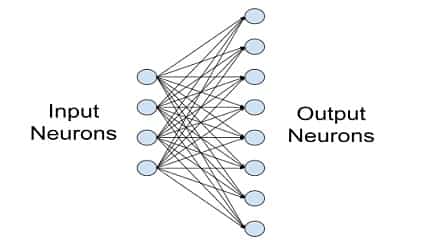

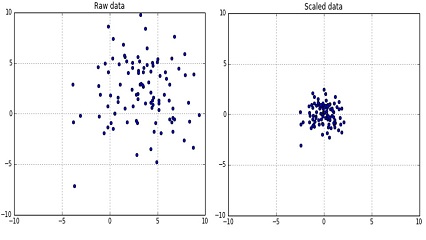

شبکه های عصبی به صورت کلی تعداد پارامتر زیادی دارند و متناسب با این پارامترها نیاز به متغیر و فضای ذخیره سازی داریم؛ با این حال، در گجت های قابل حمل مثل تلفن همراه، معمولا ظرفیت حافظه بسیار کم است. یکی از روشها برای کاهش حجم مدلها، تغییر نوع داده ها است. به جای استفاده از نوع float برای داده ها از نوع int هشت بیتی استفاده می کنیم. در نگاه اول شاید به نظر برسد که این موضوع باعث کاهش عملکرد بشود ولی باید اشاره کرد که این موضوع به صورت کلی چشم گیر نیست. اگر rounding error را تصادفی فرض کنیم و به محاسبات خطی شبکه ها به صورت میانگین وزن دار نگاه کنیم، می توان انتظار داشت که خطاها همدیگر را cancel می کنند. در این حالت از 32 بیت به 8 بیت رسیده ایم و عملکرد چندان پایین نیامده است.

نوشته شده بوسیله:

کامران پناهی

کارشناسی ارشد هوش مصنوعی

علاقه مند به یادگیری عمیق